Fonte: da redação PLS

Atualizado em: 9 março, 2026

Pesquisa filosófica financiada pela FAPDF expõe o abismo entre o que a inteligência artificial calcula e o que ela de fato compreende — e por que essa distinção importa para sua saúde, seu emprego e seus direitos

Ela já escolheu currículos, auxiliou em diagnósticos médicos e embasou análises jurídicas. A inteligência artificial está presente no celular, no trabalho e nos serviços públicos — e age com uma rapidez que impressiona. Mas pesquisadores da Universidade de Brasília (UnB) fizeram uma pergunta que poucos ousam formular em voz alta: a IA realmente entende o que faz — ou apenas imita entendimento com enorme eficiência?

A resposta, construída ao longo de uma pesquisa apoiada pela Fundação de Apoio à Pesquisa do Distrito Federal (FAPDF), é desconfortável: imita. E isso muda tudo.

Quando o Algoritmo Acerta Sem Entender Por Quê

O projeto “Inteligência Artificial: Desafios e Limites”, desenvolvido no Departamento de Filosofia da UnB e coordenado pelo professor Philippe Claude Thierry Lacour, investiga os fundamentos epistemológicos da IA — ou seja, as bases do que esses sistemas realmente “sabem”.

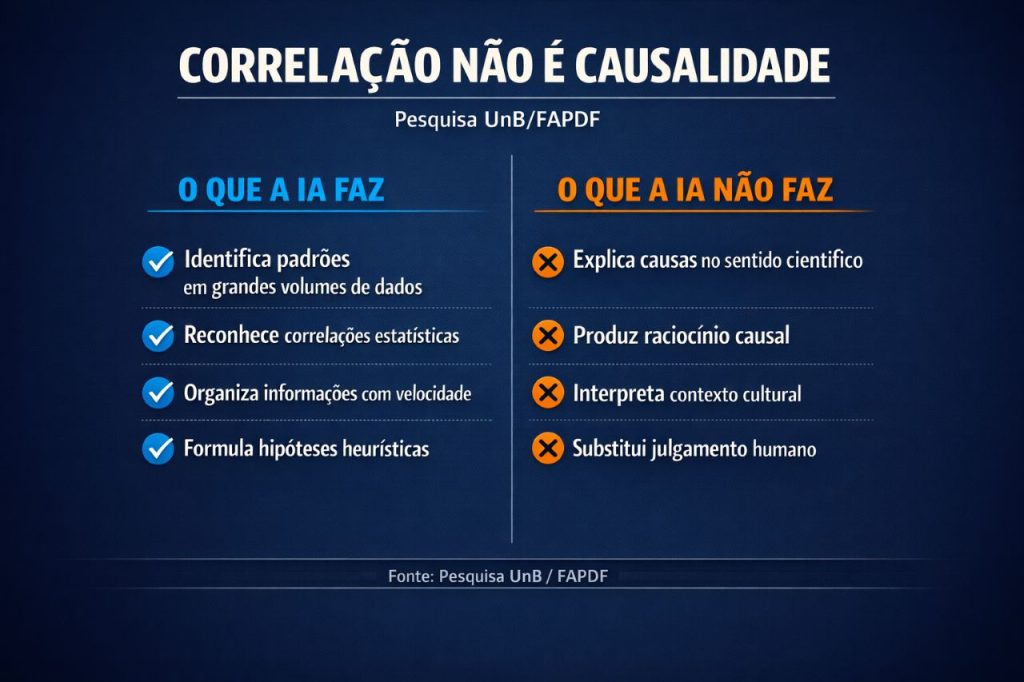

A conclusão central da pesquisa é direta: os grandes modelos de linguagem que sustentam ferramentas como chatbots, diagnósticos automatizados e sistemas de seleção de candidatos são eficientes em identificar padrões. Mas identificar padrões não é explicar causas.

“A inteligência artificial opera principalmente por cálculo formal, probabilidade e indução. O problema é que esses mecanismos não esgotam as formas de racionalidade que estruturam o conhecimento humano.” — Professor Philippe Lacour, coordenador do projeto

Em linguagem simples: a IA pode dizer que pessoas com determinado perfil tendem a ter certa doença. Mas não consegue explicar por que — no sentido científico de causalidade. Ela identifica a correlação. Não a causa.

A Diferença Que Pode Custar Sua Liberdade ou Sua Saúde

Essa distinção não é filosófica no sentido abstrato. Ela é concreta e urgente.

Imagine um algoritmo usado por um tribunal para recomendar penas ou liberdades. Ele identifica que réus com certo perfil demográfico reincidiram mais no passado. E condena com base nisso. A correlação existe — mas onde está a explicação? Onde está a justiça?

Ou um sistema de saúde que detecta padrões de exames e sugere diagnósticos. Ele acerta na média. Mas para o paciente fora da média — o que acontece?

A IA é racional, mas não é uma ciência completa, resume Lacour. E usar uma ferramenta como se ela fosse mais do que é tem consequências reais para pessoas reais.

A Babel Digital: Como a Tradução Revelou o Limite dos Algoritmos

Para demonstrar sua tese, a pesquisa recorre a um campo histórico e revelador: a tradução automática — justamente a área que deu origem à inteligência artificial como campo científico.

Traduzir parece simples. É trocar palavras de uma língua por equivalentes em outra, certo?

Errado. Traduzir é interpretar. É entender que “saudade”, em português, não tem equivalente direto em inglês. Que um texto filosófico alemão do século XVIII carrega contextos que nenhuma frequência estatística de palavras consegue capturar.

Os algoritmos de tradução processam bilhões de textos e acertam na maioria dos casos cotidianos. Mas diante de ambiguidade cultural, ironia, metáfora filosófica — tropeçam. Porque o sentido não está nas palavras. Está no humano que as usa.

Esse exemplo, segundo os pesquisadores, ilumina um princípio maior: existem dimensões da racionalidade humana que não podem ser integralmente formalizadas por algoritmos.

Os Riscos Que a Euforia Tecnológica Prefere Ignorar

A pesquisa da UnB cataloga críticas à IA em dois eixos. O primeiro é interno — os próprios limites técnicos do cálculo probabilístico. O segundo é externo — e envolve impactos que já afetam a vida de milhões:

- Vieses algorítmicos: sistemas treinados com dados históricos reproduzem e amplificam preconceitos históricos — de raça, gênero, classe.

- Riscos à privacidade: o treinamento de grandes modelos consome quantidades imensas de dados pessoais, muitas vezes sem consentimento informado real.

- Concentração de poder tecnológico: poucas empresas, majoritariamente americanas, controlam a infraestrutura que processa as decisões do planeta.

- Consumo energético: cada interação com uma IA é processada em data centers que consomem energia permanentemente. Quanto maior e mais complexo o modelo, maior o custo. A expansão acelerada da IA já levanta alertas sérios sobre sustentabilidade ambiental em plena crise climática.

“Compreender a inteligência artificial é condição para utilizá-la de forma responsável.” — Conclusão do projeto, FAPDF/UnB

Brasília Como Polo de Pensamento Crítico

O projeto foi viabilizado pelo edital Demanda Espontânea 2023 da FAPDF, inserido no Programa de Pesquisa Básica — voltado a pesquisas em estágio inicial de maturidade tecnológica (TRL 1 a 3). O financiamento permitiu bolsas de iniciação científica, produção acadêmica e cooperação internacional.

Para Lacour, o apoio foi decisivo: “O fomento da FAPDF foi crucial para estruturar uma dinâmica coletiva de investigação, formar estudantes e ampliar cooperações internacionais. Nosso objetivo é consolidar, no Distrito Federal, um polo de reflexão crítica sobre inteligência artificial.”

O professor aponta ainda que futuras gerações de IA poderão evoluir para arquiteturas baseadas em “modelos de mundo” — sistemas capazes de representar e compreender melhor a realidade, indo além da correlação estatística. Mas isso ainda é horizonte, não presente.

O Que Está em Jogo

Vivemos um paradoxo: quanto mais poderosa se torna a IA, menos a sociedade questiona seus limites. A tecnologia avança na velocidade do mercado; a regulação e a reflexão crítica, na velocidade das instituições — muito mais lenta.

A pesquisa da UnB não pede o fim da inteligência artificial. Pede algo mais difícil: maturidade intelectual para usar uma ferramenta extraordinária sem confundi-la com o que ela não é.

Porque delegar decisões sobre saúde, liberdade e emprego a um sistema que calcula sem compreender — isso sim é o verdadeiro risco que os números não conseguem mostrar.